Partager la publication "Faux, Kylian Mbappé n’a pas lancé une application pouvant rendre les Guinéens riches !"

Cette vidéo (lien archivé d’un démenti) qui prétend montrer le joueur international français Kylian Mbappé présenté sa supposée application est fausse. Il s’agit d’une Deepfake malveillante. Dans la vidéo de 56 secondes publiée le 1er mars sur le réseau social Facebook, de la 7e seconde à la 15e seconde, on aperçoit le célèbre footballeur, vêtu d’un costume-cravate noire avec une chemise blanche, annoncer le lancement d’une application pouvant rendre riches les internautes guinéens. La vidéo a été initialement publiée sur le réseau Facebook. Peu de temps après, elle a été supprimée par son auteur. Nous l’avons retrouvée sur X, (lien archivé d’un démenti), anciennement Twitter, et avons décidé d’enquêter afin de distinguer le vrai du faux.

« Mon application Aztec castel sera limitée dans le temps. Elle fonctionnera exactement pendant 30 jours », entend-on dans la vidéo dont les propos sont attribués au champion du monde de football 2018, qui s’empresse d’encourager les utilisateurs à utiliser l’appli : « Dépêchez-vous de la télécharger et devenez plus riche.» (SIC).

Entre la 30e et la 39e seconde, il affirme : « Je suis très satisfait de notre résultat pour le moment. Nous avons déjà distribué plus de 10 milliards. Tout ce que vous avez à faire, c’est de télécharger [l’application] et de jouer».

Capture d’écran effectuée sur la vidéo truquée de Mbappé

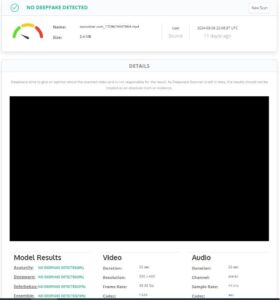

Dans nos recherches, nous avons fait recours à Deepware, un outil disponible gratuitement et qui permet, en temps normal, de savoir si une vidéo est réelle ou truquée. Malheureusement, les recherches se sont révélées infructueuses.

Résultats de la recherche sur Deepware

Pour aller plus loin, c’est en utilisant l’outil InVid WeVerify que nous avons réussi à segmenter la vidéo afin d’obtenir des images clés nous permettant d’effectuer une multiple recherche d’images inversée (voici comment procéder). Les résultats ont prouvé qu’il s’agit d’une vidéo générée par une intelligence artificielle dans le but de tromper les internautes.

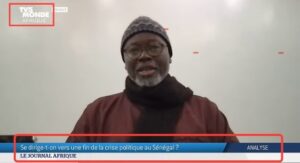

Dans son modus operandi, l’auteur s’est servi d’une application pour réaliser sa deepfake. Grâce à l’intelligence artificielle, son auteur est parvenu à faire un clonage vocal pour simuler la voix de Kylian Mbappé et de la journaliste Dominique Tchimbakala de TV5 Monde Afrique pour leur faire tenir des propos qu’ils n’ont jamais tenus. (voir un extrait de la vidéo originale ici)

En analysant la vidéo, on constate un décalage entre la voix et le mouvement des lèvres du footballeur et de la présentatrice ainsi que des visages paumés. De quoi remettre en cause l’authenticité de leurs propos. Autre élément non des moindres : la taille de “AFRIQUE” dans la deepfake est plus petite que celle qu’utilise la chaine TV5. La police utilisée n’est pas la même au niveau du titre et du sous-titre.

Capture d’écran de la vidéo fake pour montrer le trucage du logo et les sous-titres.

Capture d’écran effectuée sur une vidéo d’Alioune Tine sur la chaine YouTube de TV5 pour montrer l’authenticité du logo et les sous-titres.

En réalité, la vidéo vise à promouvoir Aztec Castle (lien archivé) , décrit comme un « jeu d’entraînement cérébral basé sur le 2048 original, mais vraiment plus difficile à réaliser. Vous êtes le dieu aztèque sauvage capable de manger tous vos ennemis, mais vous devez vous préparer à chaque objectif avec des modifications spécifiques. Mangez un ennemi bleu pendant que vos yeux brûlent en bleu, en vert pour les ennemis verts, etc. Préparez-vous à une aventure stimulante ».

Capture d’ecran de l’appplication sur AppStore

L’analyse du lien de l’application avec l’outil virustotal a mis en évidence la présence de virus pouvant infecter ou endommager un appareil.

Les résultats de l’analyse du lien de l’application montrant qu’elle est infectée.

A partir de la 27e seconde, la vidéo montre deux jeunes se faisant une accolade et laissant exploser leur joie. Nous avons retrouvé l’original. Il s’agit en réalité d’une rencontre surprise entre un jeune, son frère et sa mère qu’il n’a pas vus depuis 10 ans.

La retrouvaille entre un jeune, son frère et sa mère qu’il n’a pas vus depuis 10 ans.

Contactée dans le cadre de notre enquête, la présentatrice Tchimbakala n’a pas souhaité directement réagir. Mais sur son compte X, elle a indiqué que “l’intelligence artificielle (IA) se perfectionne”, avant d’appeler à la vigilance. “Observez les mouvements des lèvres… La voix et le texte ont été fabriqués par ordinateur et plaqués sur la vidéo. Surtout, si vous m’entendez prononcer #Mbappé M-Bappé… sachez que ce n’est pas moi!”, a-t-elle ajouté.

L’Intelligence Artificielle #IA se perfectionne, soyons donc vigilants. Observez les mouvements des lèvres… La voix et le texte ont été fabriqués par ordinateur et plaqués sur la vidéo. Surtout, si vous m’entendez prononcer #Mbappé M-Bappé… sachez que ce n’est pas moi! 😉 https://t.co/UczA6x6Uti

— DominiqueTchimbakala (@TCHIMBAKALA1) March 19, 2024

Verdict :

La vidéo attribuée à Kylian M’Bappé promouvant une application permettant aux Guinéens d’être riches est fausse et est infectée d’un virus. Il s’agit d’une Deepfake. Faites attention et surtout ne téléchargez PAS cette application.

Cet article a été rédigé par Ciré Baldé et Mamadou Mouctar Diallo dans le cadre du projet d’Éducation au Média à l’Information et au Numérique Plus (EMIN+) avec le soutien de l’Organisation Internationale de la Francophonie (OIF). Il a été édité par Thierno Ciré Diallo et approuvé par le directeur de la publication, Sally Bilaly SOW.

Une information à vérifier ? Une erreur à signaler dans l’article ? Ecrivez-nous à: alertes@guineecheck.org ou sur WhatsApp/Telegram/Signal au : +224 664 43 20 23 ou via l’ensemble de nos canaux sur les réseaux sociaux.

Comments